Комп'ютерні системи навчилися в людей використовувати гендерні і расистські стереотипи

Науковці Прінстонського університету, які вивчають специфіку штучного інтелекту з'ясували, що новітні комп'ютерні системи під час навчання роботі з мовою на прикладі реально існуючих текстів, можуть «вивчити» приховані в них гендерні та расові стереотипи. Про це йдеться у публікації журналу Science.

Автори нового дослідження штучного інтелекту, припустили, що комп'ютерні системи не лише засвоюють структуру природної мови, але й переймають особливості семантики, яка історично закріпилася у мові. Для перевірки своєї гіпотези, вчені розробили спеціальний алгоритм Word-Embedding Association Test (WEAT), який є комп'ютерним аналогом психологічного тесту підсвідомих асоціацій (IAT). Цей алгоритм вивчає статистику асоціативно пов'язаних слів: чим частіше два слова зустрічаються в текстах на порівняно невеликій відстані одне від одного, тим частіше вони асоціюються між собою. Алгоритм проаналізував корпус інтернет-текстів з 840 млрд слів.

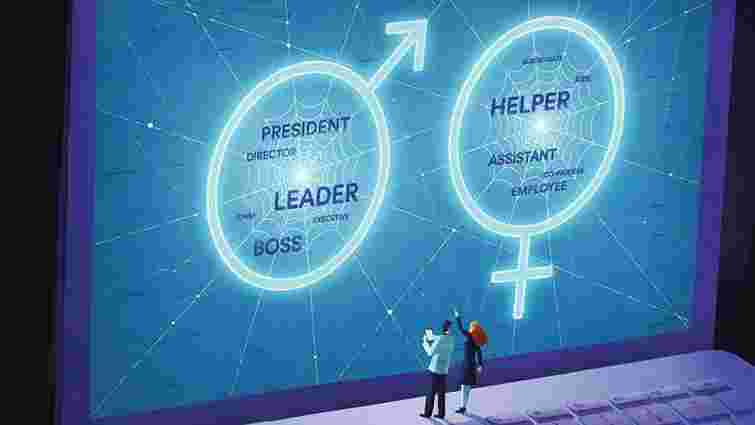

Назви квітів (троянда, маргаритка) асоціювалися з позитивними поняттями (ласка, любов), а назви комах - з негативними («бруд», «потворний»). Поєднавши корпус текстів з базою імен, які часто зустрічаються у американців європейського або африканського походження, штучний інтелект «виявив», що європейців зазвичай асоціюють з такими поняттями, як «сім'я», «друг», «щасливий», а афроамериканців - зі словами «бідність», «в'язниця» , «вбивство». Також з'ясувалося, що чоловічі імена частіше асоціюються з поняттями зі сфери кар'єри («професіонал», «заможний»), а жіночі - з сімейними («материнство», «весілля»).

Дослідники також показали наочний приклад, як впроваджені системи штучного інтелекту не просто фіксують стереотипи, але й використовують їх у роботі. Наприклад, Google Translate перекладає турецьке гендерно нейтральний займенник «о» в залежності від професії: «o bir doktor» - «він лікар», але «o bir hemsire» - «вона медсестра».

Оперативні, достовірні і найважливіші новини тут Додайте ZAXID.NET у вибрані в GoogleАвтори статті наголосили, що в майбутньому подібні особливості систем штучного інтелекту можуть негативно позначитися на їх роботі. Наприклад, якщо наповнені забобонами програми будуть використовуватися для попереднього відбору резюме, це призведе до несправедливих рішень. Окрім того, навчаючись на сучасних текстах, алгоритми можуть укорінити у людському сприйнятті стереотипи, що в них зустрічаються.